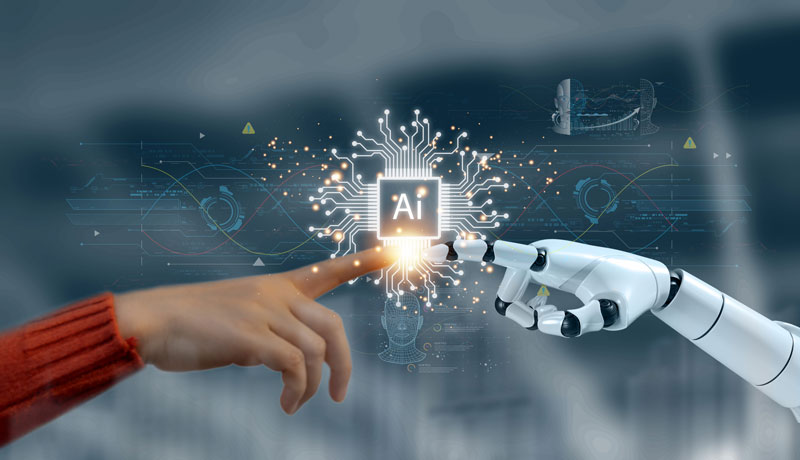

L’intelligence artificielle, un défi pour notre société

L’intelligence artificielle (IA) révolutionne notre monde, mais soulève également de nombreuses questions éthiques. De l’éducation au monde professionnel, en passant par la santé et la sécurité, l‘IA nous confronte à des dilemmes moraux inédits.

Explorons ensemble les principaux enjeux éthiques de l’IA et les pistes pour concilier progrès technologique et valeurs humaines.

Les principaux enjeux éthiques liés à l'intelligence artificielle

Dès les premiers jours du développement de l’intelligence artificielle, de nombreuses questions d’éthique ont été soulevées. En termes d’enjeux liés à cette technologie qui monte en puissance, on note principalement :

- Le risque d’utilisation des données en vue d’influencer le comportement des individus ;

- Les entraves à la vie privée et la surveillance compte tenu de la divulgation des données travaillées ;

- L’opacité des systèmes intégrant l’IA relativement à la prise de décision ;

- Les biais qui affectent la qualité du rendu des systèmes de décision ;

- La responsabilité et les risques des systèmes autonomes (véhicules et armes autonomes), etc.

Autant d’interrogations que suscite l’essor de ces logiciels capables d’effectuer des tâches complexes normalement réservées aux humains.

L'impact de l'IA sur la vie privée et la protection des données

La question de la vie privée et la protection des données fait partie des plus essentielles que soulève le déploiement de l’IA.

L’utilisation de cette technologie engendre en effet des risques comme :

- L’atteinte aux données à caractère personnel collectées parfois à l’insu de l’utilisateur ;

- L’accentuation des erreurs humaines en matière de discriminations (sexistes ou racistes) ;

- Les atteintes à la vie privée en cas d’utilisation pour les opérations de surveillance de masse ;

- La procrastination et la dépendance suscitées par les outils, etc.

Ce sont les différents défis qu’il importe de considérer dans le développement de l’IA.

Les biais algorithmiques : un défi majeur pour une IA équitable

Par biais algorithmique, on entend des cas où une machine ou une personne, opère un traitement discriminatoire, inégalitaire, entre deux types de population. Selon les cas, on distingue :

- Les biais de sélection qui surviennent au cas où les données utilisées pour entraîner un algorithme ne sont pas représentatives de la population à modéliser ;

- Les biais de confirmation qui conduisent généralement à ignorer ou à minimiser des données ou des résultats qui contredisent ces hypothèses ;

- Les biais d’algorithmie liés intimement à la conception et l’optimisation de l’algorithme

Chacun de ces biais présente des conséquences évidentes sur l’expérience avec IA.

La transparence et l'explicabilité des systèmes d'IA

Au rang des grands défis des systèmes d’IA, on retrouve la transparence et l’explicabilité.

Sur le point de la transparence algorithmique, il s’agit d’un défi visant à renforcer la confiance des utilisateurs dans les plateformes numériques tout en leur donnant plus de contrôle sur leur expérience en ligne. Elle englobe les éléments comme la transparence sur les mécanismes des algorithmes utilisés par IA, le contrôle sur les publicités et le choix des préférences.

Il faut ajouter à la transparence l’explicabilité des algorithmes. Avec de plus en plus d’algorithmes qui organisent les domaines de la vie publique (détection des infractions routières, tarification des droits d’accès à certains services, calculs…), il n’est pas question de laisser l’utilisateur informé seulement lorsqu’un dysfonctionnement survient.

Les décisions administratives basées sur les algorithmes doivent être détaillées, individualisées et compréhensibles par l’usager concerné.

Quelle responsabilité en cas de décision erronée d'une IA ?

Il est logique, parlant du développement de l’IA, d’évoquer l’opacité dans les prises de décisions.

Comme toutes les autres nouvelles technologies, l’intelligence artificielle pose des défis juridiques. Étant encore méconnu du grand public et des juristes, l’IA ne donne pas l’occasion de poser des barrières juridiques.

Comme toutes les autres nouvelles technologies, l’intelligence artificielle pose des défis juridiques.

Il est important pour ces derniers de la connaître, puisque, aujourd’hui, l’intelligence artificielle fait partie du monde de la justice et a vocation à l’intégrer encore plus activement dans les années à venir.

Le sujet de l’IA doit être saisi par le droit, afin de responsabiliser les acteurs mais aussi afin d‘éviter des dérives, notamment discriminatoires.

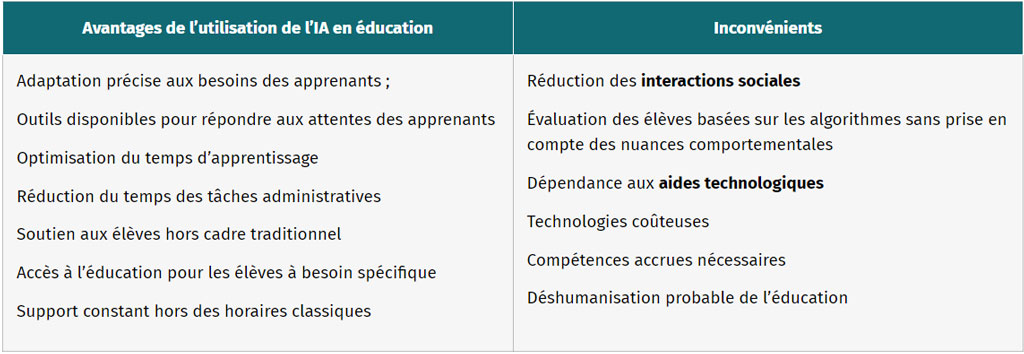

L'IA dans l'éducation : opportunités et risques éthiques

Dans le domaine de l’éducation, l’usage de l’intelligence artificielle (IA) présente autant d’avantages et de d’inconvénients pour les élèves et les enseignants.

| Avantages de l’utilisation de l’IA en éducation | Inconvénients |

|---|---|

|

Adaptation précise aux besoins des apprenants ; Outils disponibles pour répondre aux attentes des apprenants Optimisation du temps d’apprentissage Réduction du temps des tâches administratives Soutien aux élèves hors cadre traditionnel Accès à l’éducation pour les élèves à besoin spécifique Support constant hors des horaires classiques |

Réduction des interactions sociales Évaluation des élèves basées sur les algorithmes sans prise en compte des nuances comportementales Dépendance aux aides technologiques Technologies coûteuses Compétences accrues nécessaires Déshumanisation probable de l’éducation |

Les recommandations de l'UNESCO pour une IA éthique

Le tout premier instrument normatif au plan mondial sur l’éthique de l’IA a été adopté par l’Unesco en 2021. Ce dernier contient un ensemble de recommandations qui se déclinent en :

- Une conception dynamique de l’IA assurant la diversité et l’inclusion ;

- Un respect des principes de proportionnalité et d’innocuité ;

- Une promotion et un respect de la vie privée dans les systèmes d’IA ;

- La promotion des solutions IA respectant et protégeant les droits de l’homme, les libertés fondamentales et de la dignité humaine;

- Des solutions adaptées aux sociétés pacifiques et justes ;

- Une utilisation respectueuse du droit international et la souveraineté nationale ;

- Un traitement nécessaire des menaces pesant sur le bien-être de l’environnement ;

- Un déploiement des solutions lié à la transparence et l’explicabilité;

- Des actions de sensibilisation pour une éducation ouverte et accessible, etc.

Toutes ces recommandations bien que non contraignantes doivent être respectées par les acteurs de l’IA.

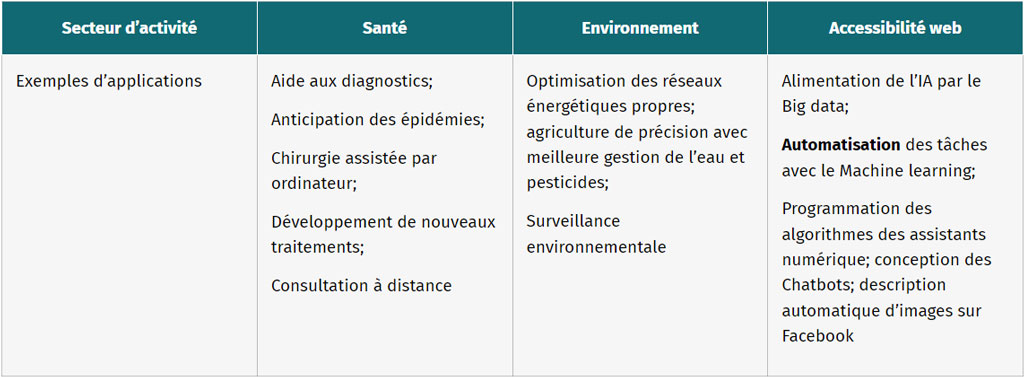

Exemples d'applications éthiques de l'IA dans différents secteurs

L’IA s’applique à divers secteurs d’activité de la vie de tous les jours. La santé, l’accessibilité et l’environnement en sont des illustrations parfaites.

| Secteur d’activité | Santé | Environnement | Accessibilité web |

|---|---|---|---|

| Exemples d’applications | Aide aux diagnostics; Anticipation des épidémies; Chirurgie assistée par ordinateur; Développement de nouveaux traitements; Consultation à distance | Optimisation des réseaux énergétiques propres; agriculture de précision avec meilleure gestion de l’eau et pesticides; Surveillance environnementale | Alimentation de l’IA par le Big data; Automatisation des tâches avec le Machine learning; Programmation des algorithmes des assistants numérique; conception des Chatbots; description automatique d’images sur Facebook |

Les initiatives pour promouvoir une IA éthique

Face aux nombreuses controverses soulevées, l’IA ne cesse de faire parler d’elle. Pour encadrer cette technologie, de nombreuses initiatives prennent corps émanant tantôt des gouvernements, des écoles tantôt des acteurs du secteur privé. C’est le cas de :

- La Belgique avec la mise en place du Comité consultatif d’éthique des données et de l’IA ;

- Le projet de création d’un office européen pour l’IA par la Commission européenne ;

- La mise en place par le gouvernement d’une fonction de coordination de l’IA dans le cabinet du Premier ministre en France ;

- L’initiative de l’IEEE sur l’éthique dans la conception des systèmes autonomes et intelligents ;

- Amazon, DeepMindGoogle, Facebook, IBM et Microsoft qui ont lancé le Partenariat pour l’intelligence artificielle au service des citoyens et de la société ;

Autant d’initiatives qui traduisent de l’engagement en faveur d’une IA éthique et responsable.

L’impact de l’IA sur l’emploi : entre craintes et opportunités

S’il y a bien un secteur qui est affecté d’une manière ou d’une autre par l’essor de l’IA, c’est bien le marché du travail. Cette technologie a entre autres effets :

- La disparition de certains emplois centrés sur des tâches répétitives et ennuyeuses que l’IA peut exécuter ;

- La rapidité dans l’exécution de certaines tâches lorsque l’IA est utilisée comme assistant du travailleur ;

- Le maintien inévitable des emplois qui demandent une grande part d’intuition et de connaissance des relations humaines (gestionnaire des ressources humaines, directeur des ventes…) ;

- La naissance de nouveaux emplois liés au développement de l’IA (pour la représentation, l’analyse des données et des algorithmes…) ;

- La nécessité de formation et la reconversion des professionnels, etc.

Ainsi se décline l’impact de l’IA sur le marché des emplois.

La réglementation de l'IA : un équilibre entre innovation et protection

Dans l’encadrement de l’IA, la réglementation a une part importante à jouer.

En effet, le déploiement rapide de l’IA souligne la nécessité d’actions décisives en vue du développement d’un cadre législatif qui tire profit des avantages de cette technologie et qui tient compte de ses risques en rapport avec les droits fondamentaux et le bien-être des travailleurs.

La jurisprudence en matière d’IA étant limitée, l’application de législations présente des incertitudes considérables.

Ainsi, il est indispensable d’opter pour une association de directives qui seront capables de guider les entreprises et d’évoluer aussi rapidement que les nouvelles technologies, et de normes contraignantes qui permettront de prévenir ou réparer les dommages causés par l’IA.

Les défis réglementaires de l’IA trahissent en effet le caractère de ce nouveau paradigme à double tranchant.

Les principes éthiques fondamentaux pour le développement de l'IA

Pour guider le développement de l’intelligence artificielle, voici quelques principes éthiques fondamentaux à suivre :

- La protection des données personnelles et le respect de la réglementation sur la confidentialité ;

- La transparence et l’explicabilité pour garantir la compréhension des actions et décisions des systèmes IA ;

- Le contrôle humain pour s’assurer que les systèmes IA respectent l’autonomie, la dignité et l’autorité décisionnelle humaines ;

- Le développement des systèmes sûrs et fiables ;

- L’éthique et l’atténuation des biais pour limiter les discriminations envers des groupes d’individus ;

- La prise en compte de l’impact plus large de l’IA sur la société, visant des contributions positives au bien-être sociétal ;

- La responsabilité à établir en cas de dommages causés par l’IA, etc.

La formation à l'éthique de l'IA : un enjeu éducatif majeur

Au regard de l’enthousiasme et des critiques suscités par l’IA, il est indispensable pour les différents acteurs qui interviennent dans la chaîne de cette technologie de bénéficier d’une formation sur les questions éthiques soulevées.

Axés sur différents modules, les formations à l’éthique de l’IA permettent d’accompagner et éveiller les apprenants aux questions d’éthique de l’intelligence artificielle.

Les équipes de formation étant transdisciplinaires, il est évident que l’écosystème des droits fondamentaux soit démystifié. Les apprenants sont amenés à saisir les différences et les équilibres entre la loi et l’éthique, deux notions distinctes.

Et si l’éthique est une réflexion intime, elle peut aussi être collective, par exemple dans le cas d’une entreprise où l’environnement guide les actions, en respectant des valeurs, des principes, une déontologie.

Ce qui est important dans ces formations c’est de savoir ce que la technique peut réellement faire aujourd’hui sans se laisser obnubiler par les fantasmes de demain.

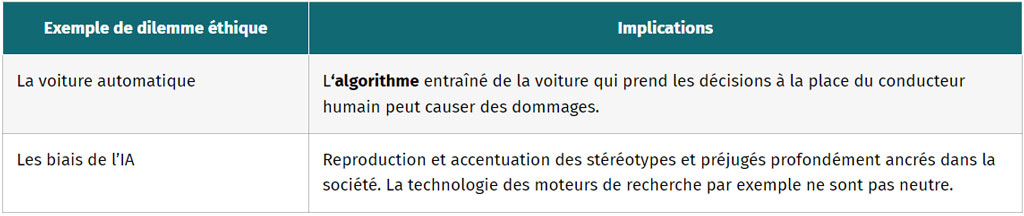

Exemples de dilemmes éthiques posés par l'IA

Par dilemme éthique, on entend une situation de prise de décision difficile qui exige un compromis entre deux options violant le code d’éthique ou des normes sociétales. Voici quelques exemples :

| Exemple de dilemme éthique | Implications |

|---|---|

| La voiture automatique | L‘algorithme entraîné de la voiture qui prend les décisions à la place du conducteur humain peut causer des dommages. |

| Les biais de l’IA | Reproduction et accentuation des stéréotypes et préjugés profondément ancrés dans la société. La technologie des moteurs de recherche par exemple ne sont pas neutre. |

L'IA et la prise de décision : jusqu'où déléguer à la machine ?

La conception des systèmes d’IA intègre généralement une délégation importante de la prise de décision. Les considérations éthiques et juridiques soulevées par l’application de l’IA doivent être examinées attentivement par les utilisateurs de cette technologie.

Il est important pour les responsables chargés de prendre les décisions en entreprises de s’assurer que les données utilisées pour la formation des outils et des technologies d’IA sont obtenues de manière éthique et que les droits à la vie privée et les réglementations en matière de protection des données soient bien respectés.

L’autre aspect important à considérer c’est celui des biais potentiels et des conséquences involontaires que les algorithmes d’IA peuvent introduire dans les processus de prise de décision.

Un suivi régulier et une évaluation des systèmes d’IA peuvent aider à identifier et à atténuer les biais ou effets discriminatoires, garantissant ainsi l’équité et la transparence dans la prise de décision.

Le rôle de l'humain dans un monde augmenté par l'IA

Avec l’intelligence artificielle (IA), les environnements de travail connaissent des transformations rapides. À côté des compétences techniques, des compétences humaines générales sont indispensables. C’est le cas de :

- La capacité d’identifier et de résoudre efficacement les problèmes ;

- La flexibilité et l’adaptabilité pour faire face aux changements ;

- La capacité de communiquer de manière efficace tant verbalement que par écrit ;

- L’intelligence émotionnelle permettant de comprendre et de gérer ses propres émotions, ainsi que celles des autres ;

- La collaboration et les dispositions au travail en équipe.

Ces soft skills sont essentielles pour exercer efficacement avec l’IA.

L'IA et les valeurs humaines : vers une symbiose éthique

Loin d’être destinée à remplacer l’humain, l’IA est appelée à renforcer ses compétences.

L’alignement de cette technologie avec les valeurs humaines fondamentales est donc une nécessité. Cet alignement peut passer plusieurs méthodes.

La première c’est l’adoption de pratiques de conception éthique plaçant la confidentialité et la protection des données personnelles au cœur du développement de produits et de services.

Aussi, un entraînement des IA sur des jeux de données diversifiés et non biaisés est impératif pour garantir l’équité des décisions algorithmiques.

L’autre méthode consiste à mettre en place de comités d’éthique multidisciplinaires pour surveiller les pratiques entourant l’IA et formuler des recommandations en vue d’un développement responsable.